我一直在测试一款声称能让 AI 生成内容听起来更自然、更像人工写作的智能 AI 人性化工具。在真正把它用到我的项目之前,我非常需要一些实际用过类似工具的用户给出坦诚的反馈。它能顺利通过查重吗?在真实读者看来够不够自然可信?会不会容易被 AI 检测工具标记出来?任何真实使用体验、优点、缺点或者需要警惕的问题,都能帮我判断这个工具是否安全、是否值得使用。

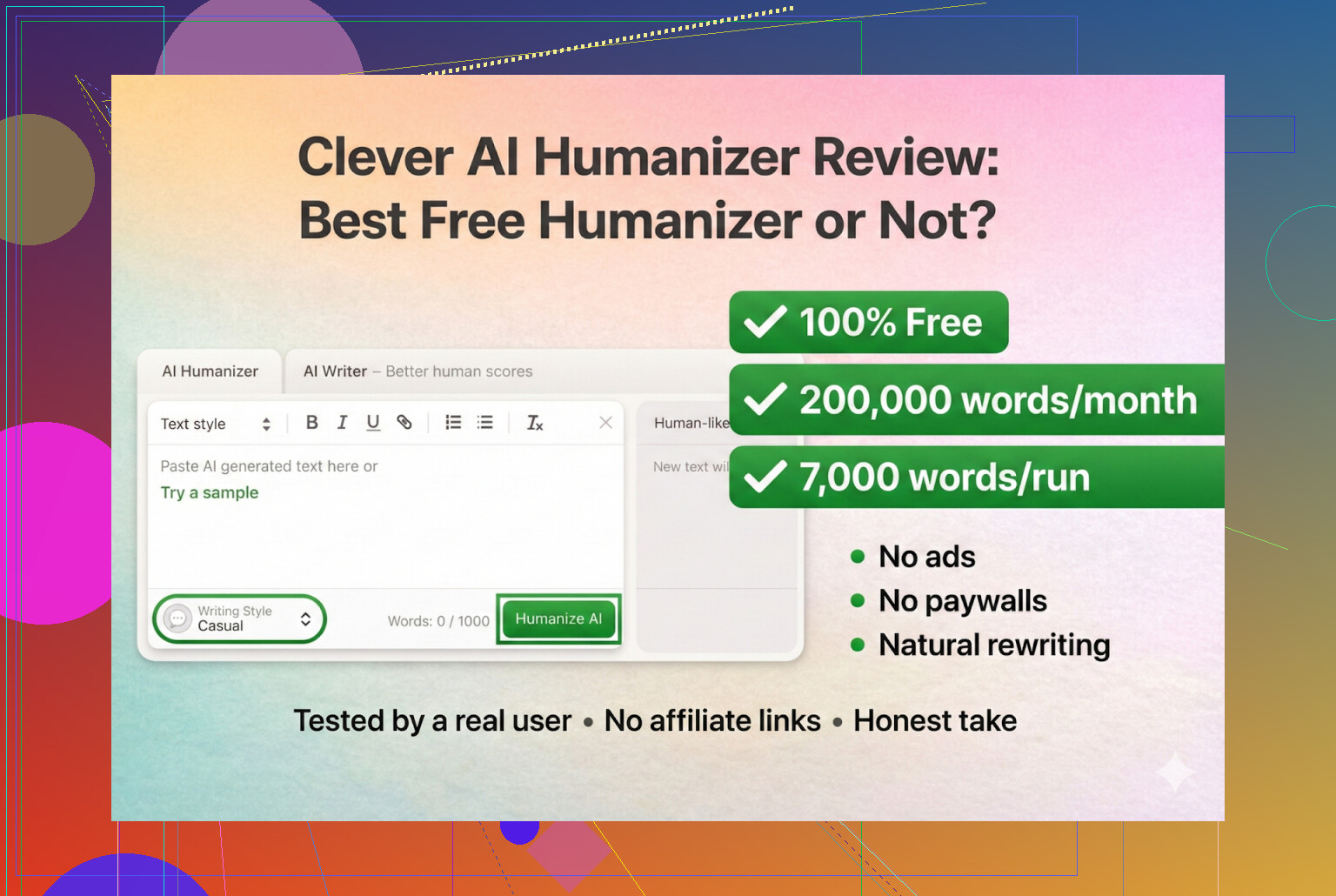

Clever AI Humanizer:我的真实体验与测试

最近我一直在折腾各种“AI 人类化(AI humanizer)”工具,主要原因是几乎每周都会有新的检测器更新,然后网络上又开始一轮恐慌帖。

这里分享一下我把 Clever AI Humanizer 拉去做了一整套测试后的结果,包括多个 AI 检测器,以及用大模型做了一次“理智检查”。

官网在这里:https://aihumanizer.net/

如果你点进了别的相似名字的网站,那就不是真正的那个。

关于假冒 “Clever AI Humanizer” 网站的提醒

这一点很关键。

有好几个人私信问我,哪个网站才是真的,因为他们点进了某个“Clever Humanizer 之类”的网站,结果遇到:

- 收费套餐

- 自动续费

- 隐形付费墙

而真正的 Clever AI Humanizer,也就是 **https://aihumanizer.net/**,在我这边从来没有出现过任何付费计划或价格页面。没有加售、没有隐藏档位,什么都没有。就我目前所见,它完全是免费的。

看起来有别的工具在买这个品牌词的广告,然后把搞糊涂的用户截走。如果你开始被要求付费,那多半不是在正版网站上。

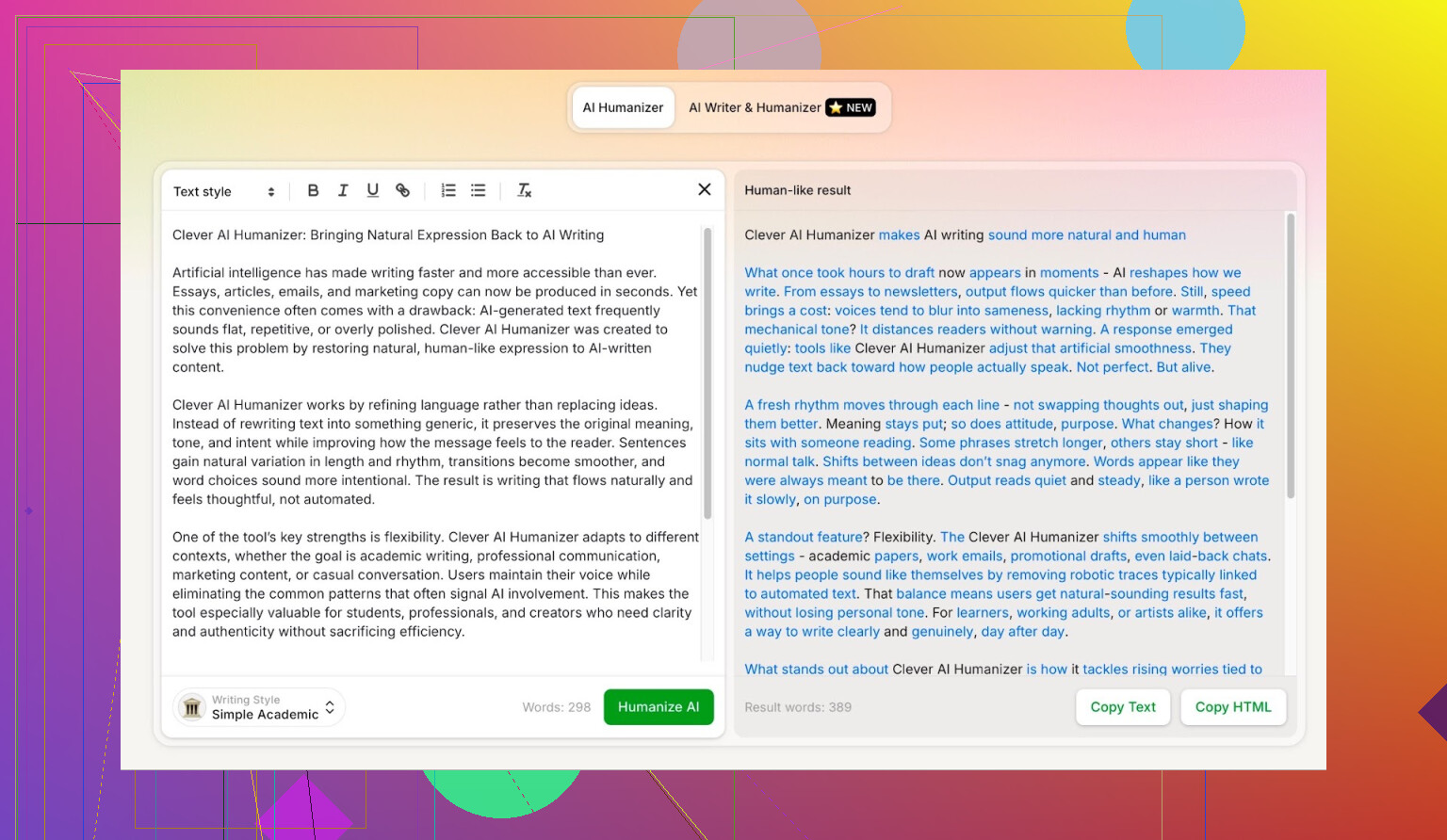

我是怎么测试的

我没有给它丢什么精修稿,也不是用我自己写的内容。

而是直接开“全自动 AI”模式:

- 让 ChatGPT 5.2 写了一篇 100% AI 生成的 Clever AI Humanizer 介绍文

- 拿到那段原始输出

- 整段粘进 Clever AI Humanizer

- 选择 Simple Academic(简易学术) 模式

为什么选 Simple Academic?

这个模式本身就比较“危险”,是故意这么选的:

- 语气略偏学术

- 但又尽量保持可读,不写成期刊论文那种

- 这种“半正式”语气,通常是 AI 检测器最敏感的区间

大部分 humanizer 都会往安全方向走,输出极度口语、极度随便的文本。而我这次一上来就选了一个偏难的模式,看它能不能在不把内容搞得乱七八糟的前提下,照样通过检测。

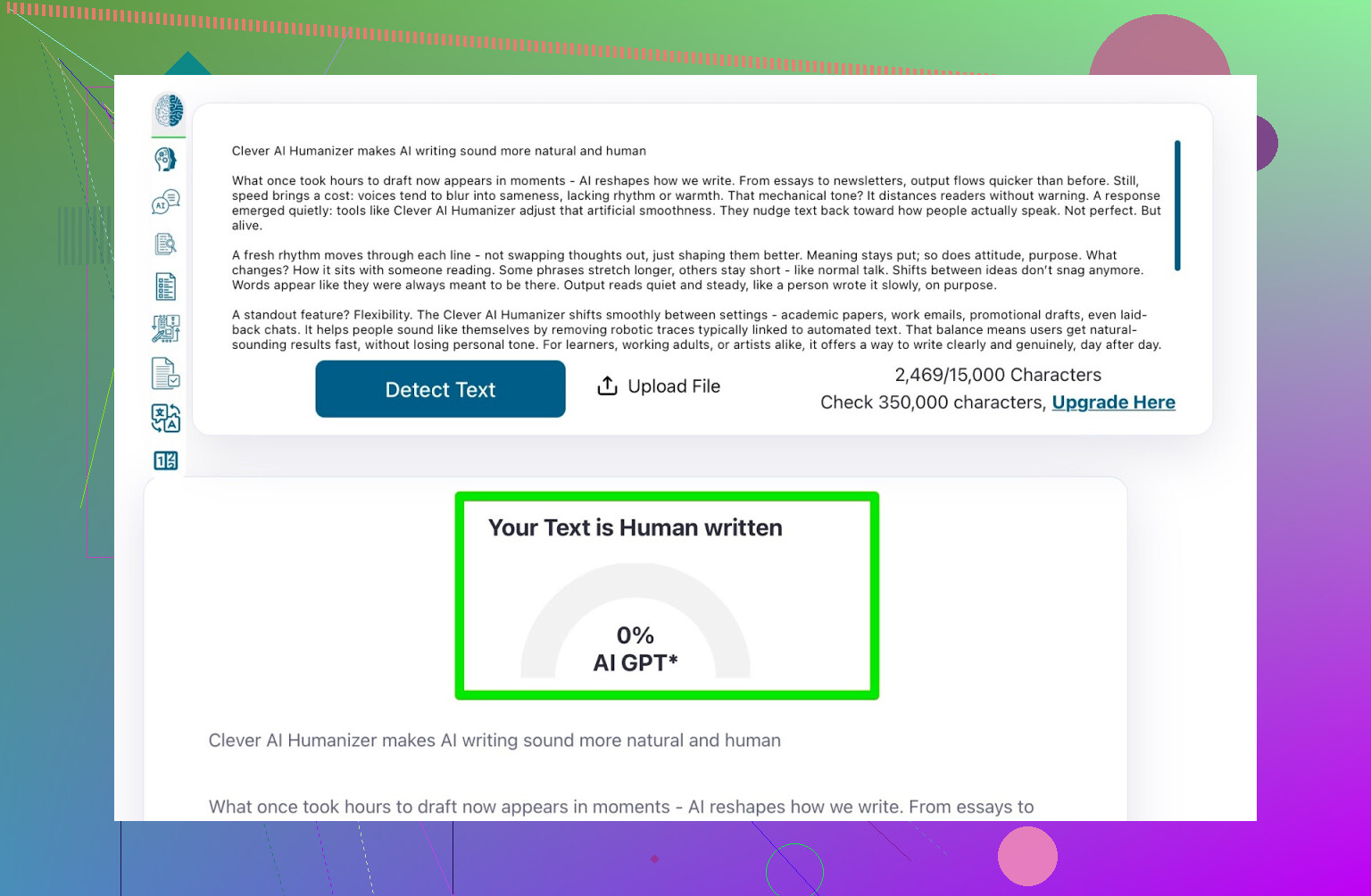

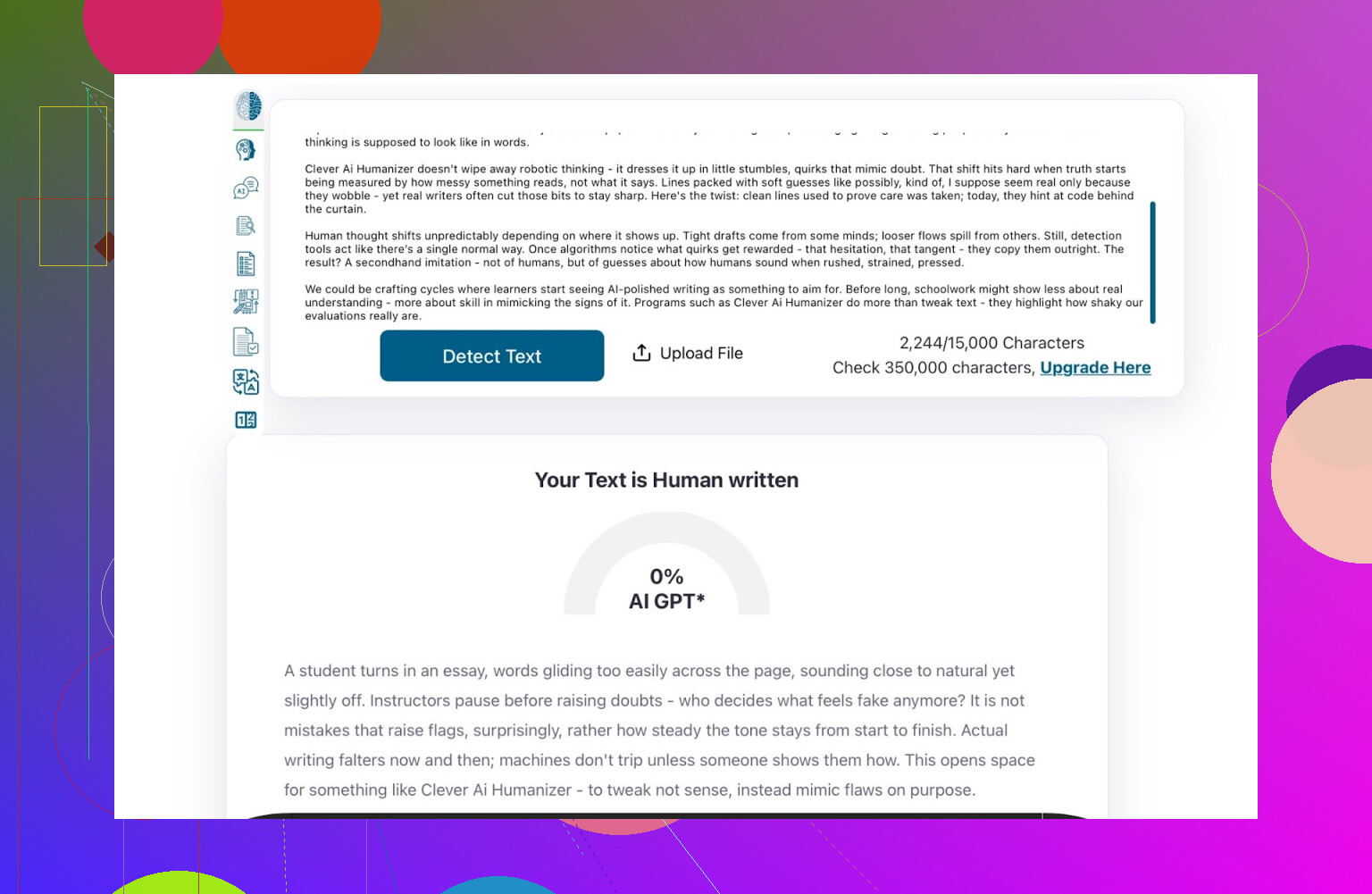

检测器测试 1:ZeroGPT

我个人并不太喜欢 ZeroGPT。之前做实验时,它把美国宪法判成 100% AI 文本,这准确率你可自行体会。

但问题在于它很流行,很多老师、甲方、管理者会用,因为它在 Google 上排得靠前。

我把人类化后的文本粘了进去。

结果:0% AI。

考虑到原文是彻头彻尾的 AI 产物,这个表现不算差。

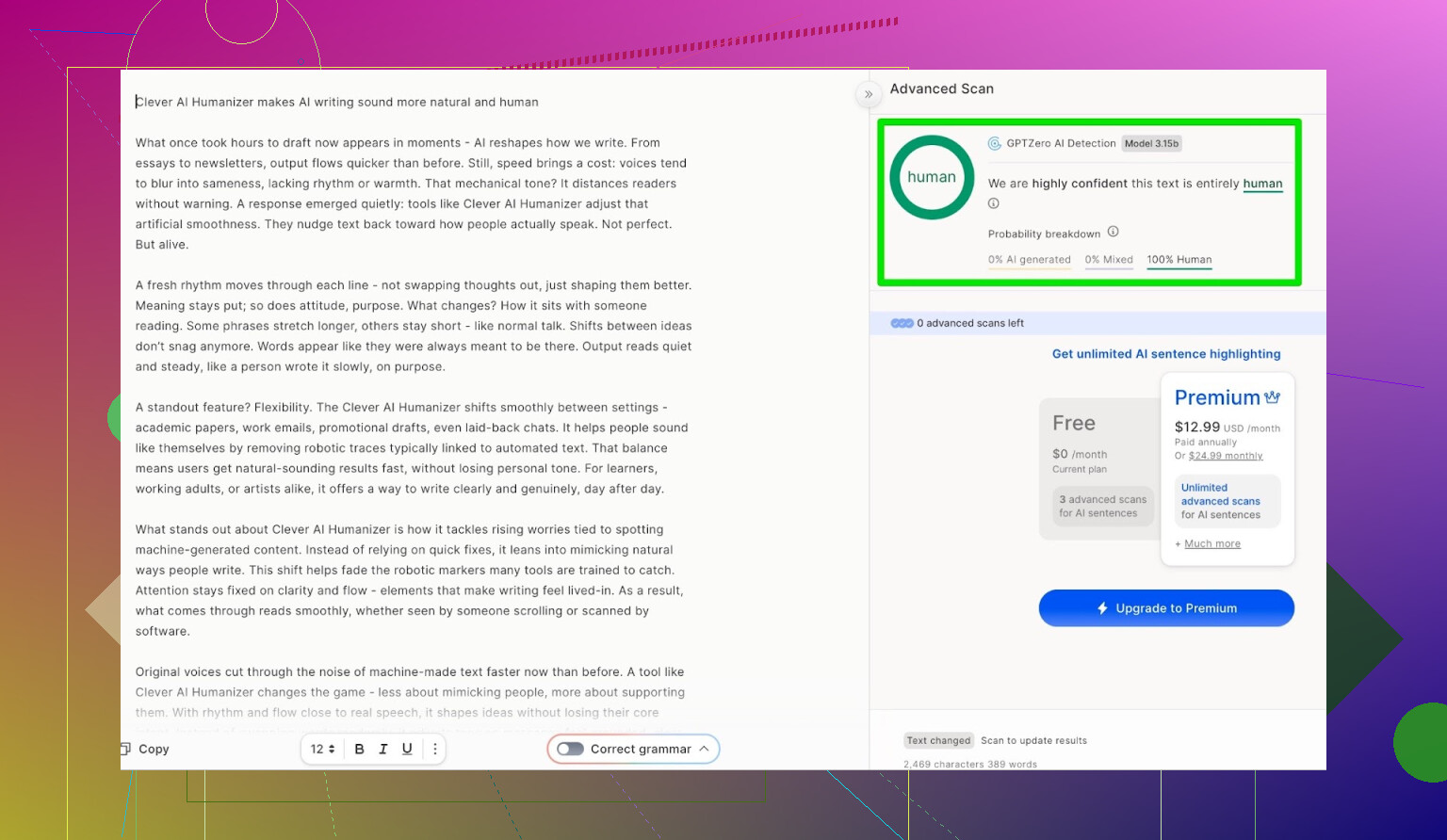

检测器测试 2:GPTZero

接着是 GPTZero。

流程一样:

- 把同一份 “Simple Academic” 输出粘进去

- 等着看熟悉的 “likely AI(很可能是 AI)” 提示

结果反而是:

- 100% human

- 0% AI

这基本就是你在用 humanizer 时,理论上能指望到的最佳结果。

但这段文字,真的像人写的吗?

光过检测意义不大,如果读起来像电冰箱说明书,那也没用。

所以我又往前多走了一步:

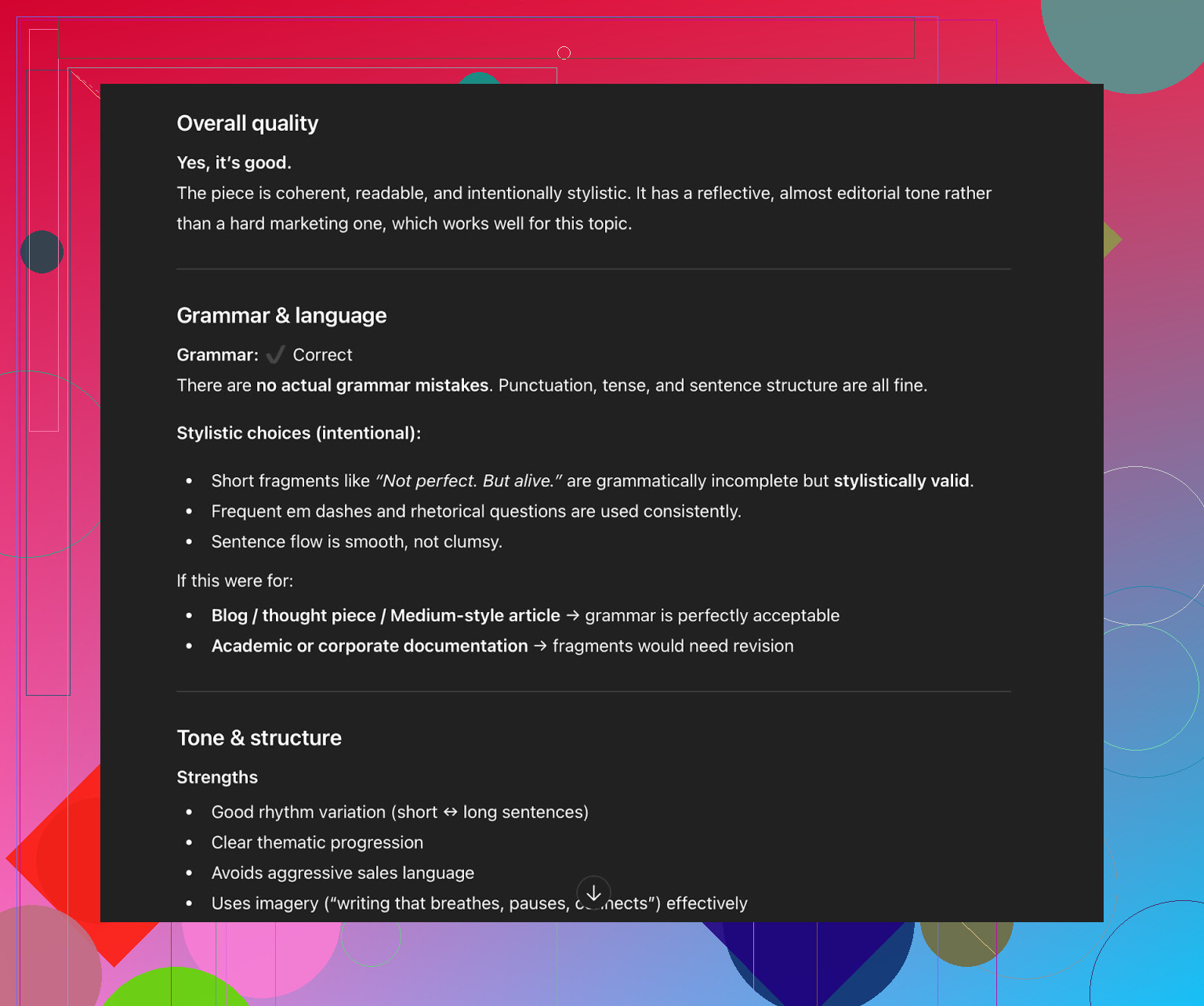

- 把输出丢回 ChatGPT 5.2

- 让它评估文本质量、语法和风格

它的结论是:

- 语法没问题

- 风格符合要求的 “Simple Academic” 气质

- 依然建议进行一次人工修改

老实说,我完全同意。

如果有人跟你说“用了这个工具就再也不用自己改稿了”,那多半是在卖梦想。我至今没见过任何一个 humanizer 或改写工具,能稳定输出完全可以不经人工就直接交稿或发表的内容。

你还是得自己:

- 修顺那些怪怪的表达

- 根据受众调整语气

- 加一点你自己的风格和具体细节

这些工具通常能帮你走到 70–90%,剩下的 10–30% 还是得靠你自己。

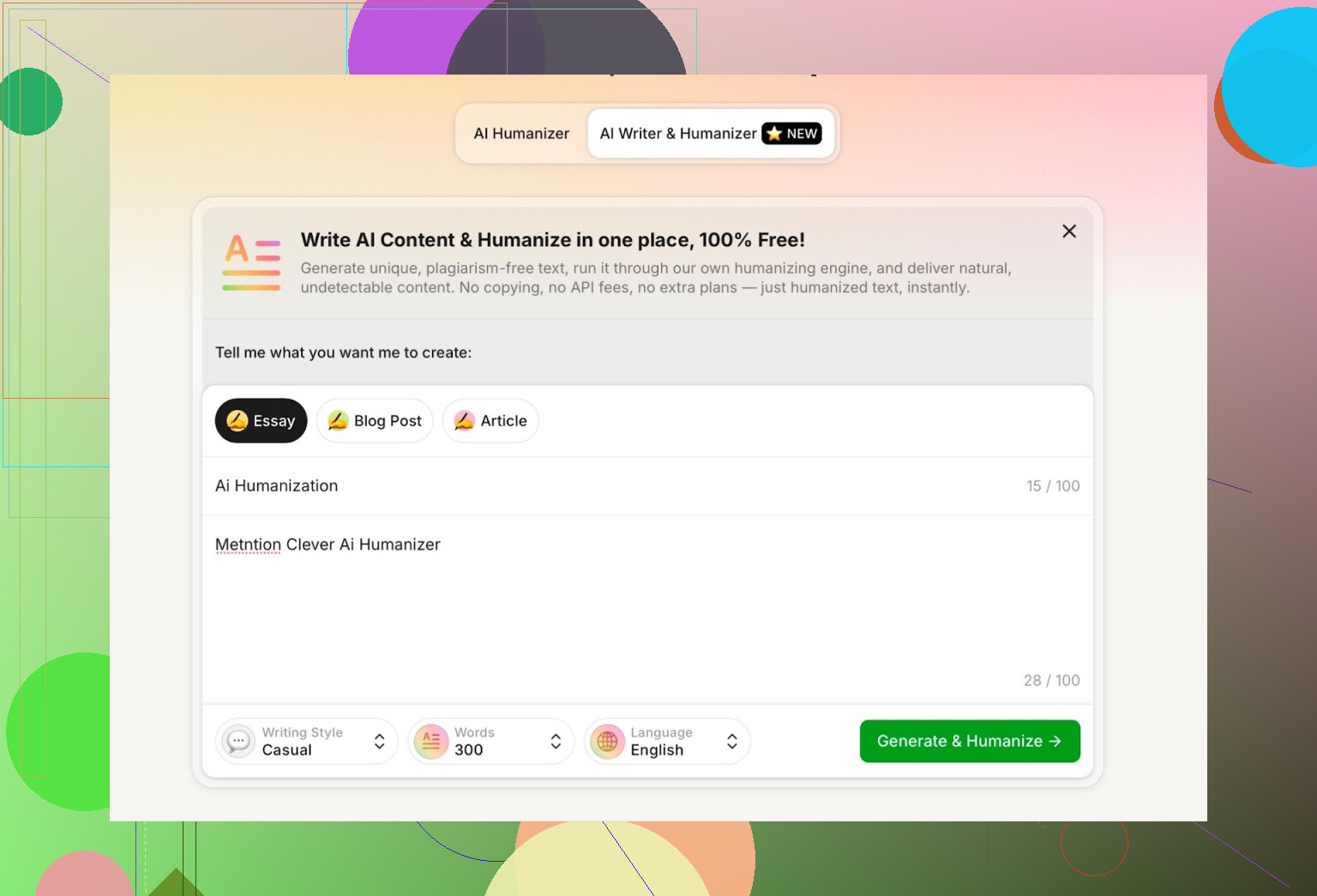

试用 Clever 自带的 AI Writer

Clever AI Humanizer 现在加了一个叫 AI Writer 的功能:

大部分 “humanizer” 网站只让你把别处的文本粘进来,然后再把它“打乱重写”。而这个是一边写一边做人类化。

这是个不小的差异,因为:

- 当工具从一开始就控制结构,就更容易避开检测器常抓的一些模式

- 也不需要在“写作 AI”和“人类化 AI”之间来回倒腾

这次测试我这样设定的:

- 风格:Casual(随意口语)

- 主题:AI 人类化,并提到 Clever AI Humanizer

- 我在提示词里故意写了一个错误,看它是照抄还是会纠正

生成出来的内容:

- 可读性没问题

- 逻辑通顺

- 但有一点让我有点烦

我指定了一个具体字数范围(比如 300 词),它给的却是明显超出这个长度的。

如果我说要 300,我就希望是 300,不是 430,也不是 220。这是我注意到的第一个明显缺点:如果你必须严格卡字数(作业、字数上限、客户硬性要求),就会比较难受。

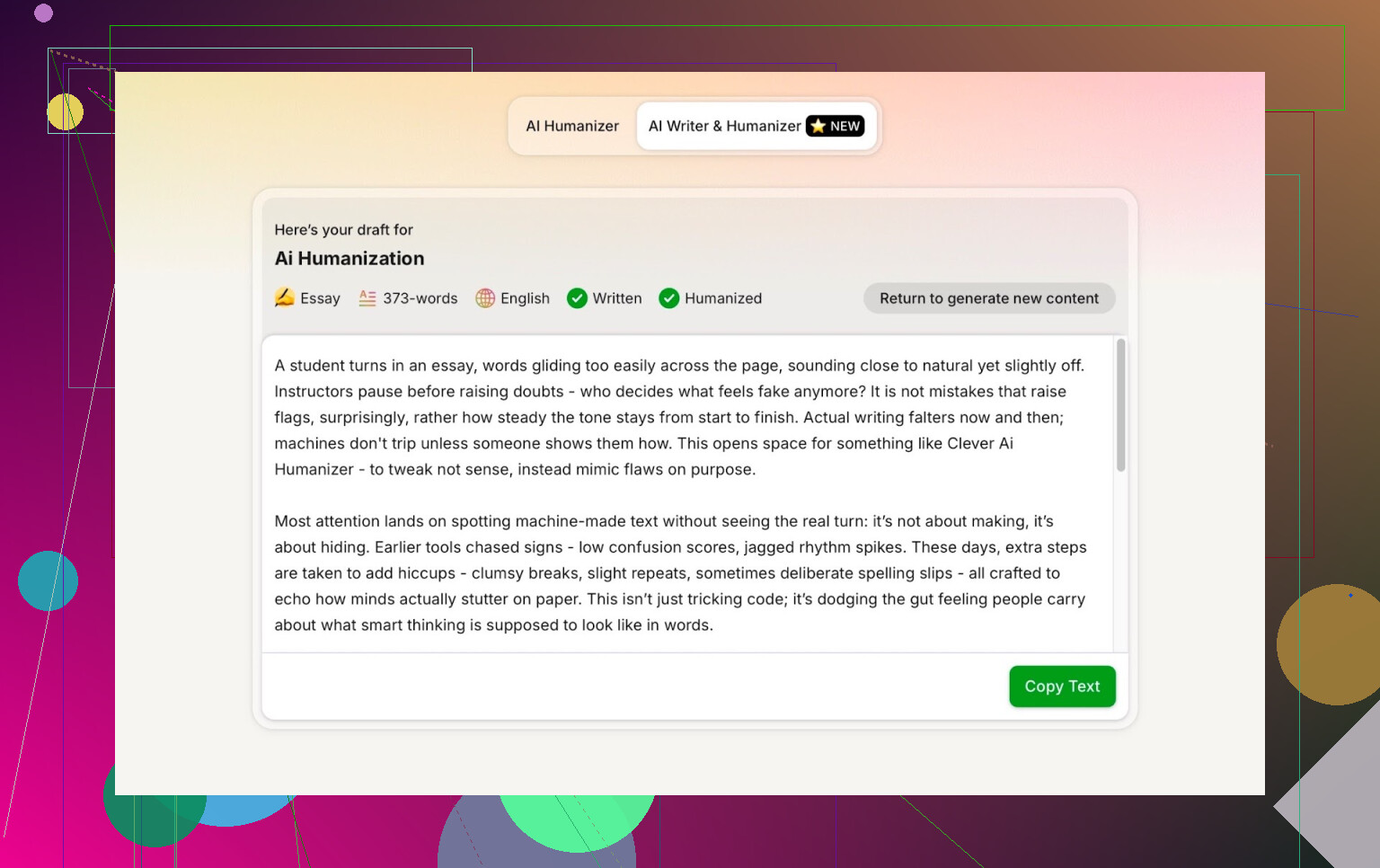

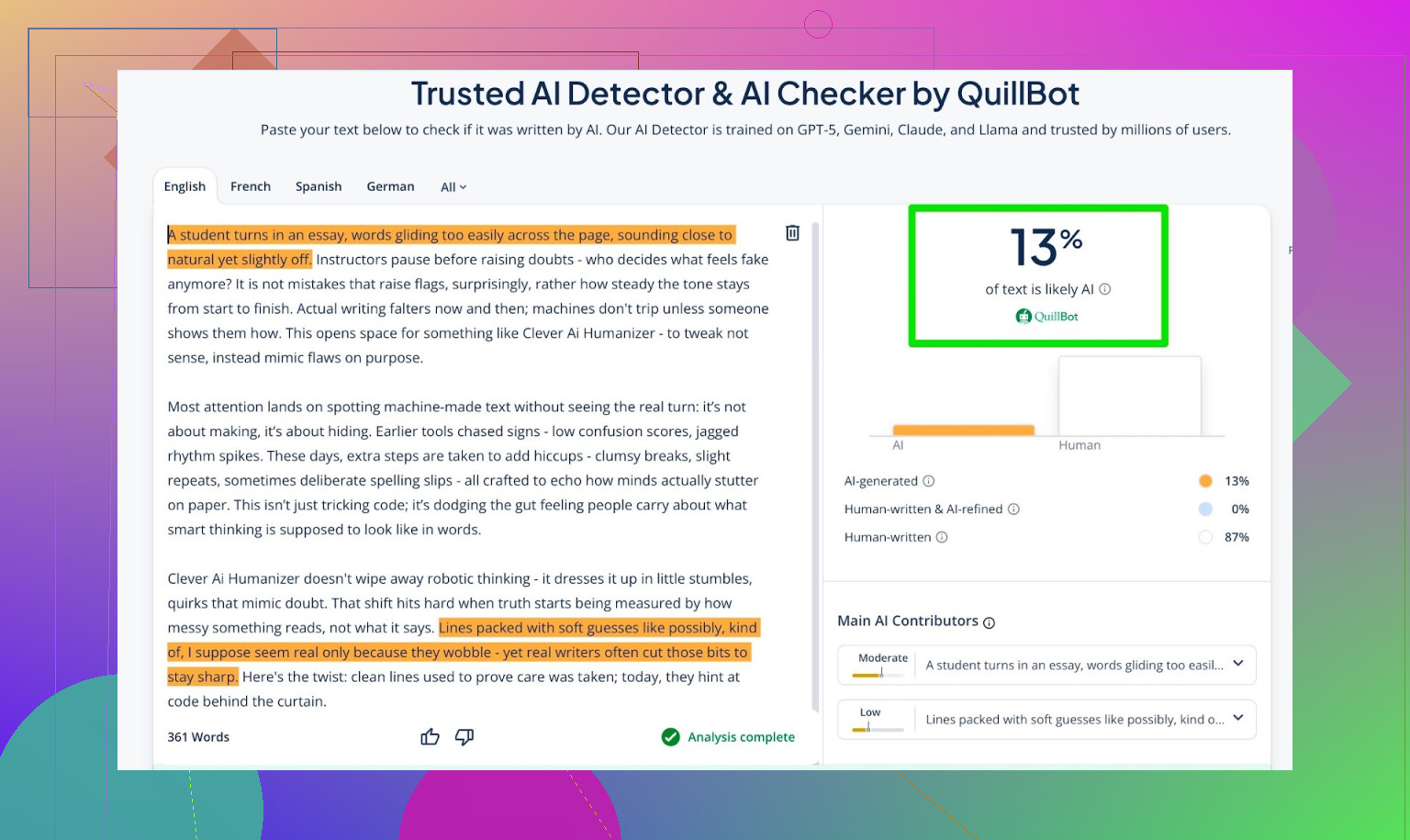

用检测器检测 AI Writer 的输出

同样流程,换一段新文本。

检测结果:

- GPTZero:0% AI

- ZeroGPT:0% AI,判为 100% human

- QuillBot detector:13% AI

以一个免费的工具来说,这个表现已经相当可以了。

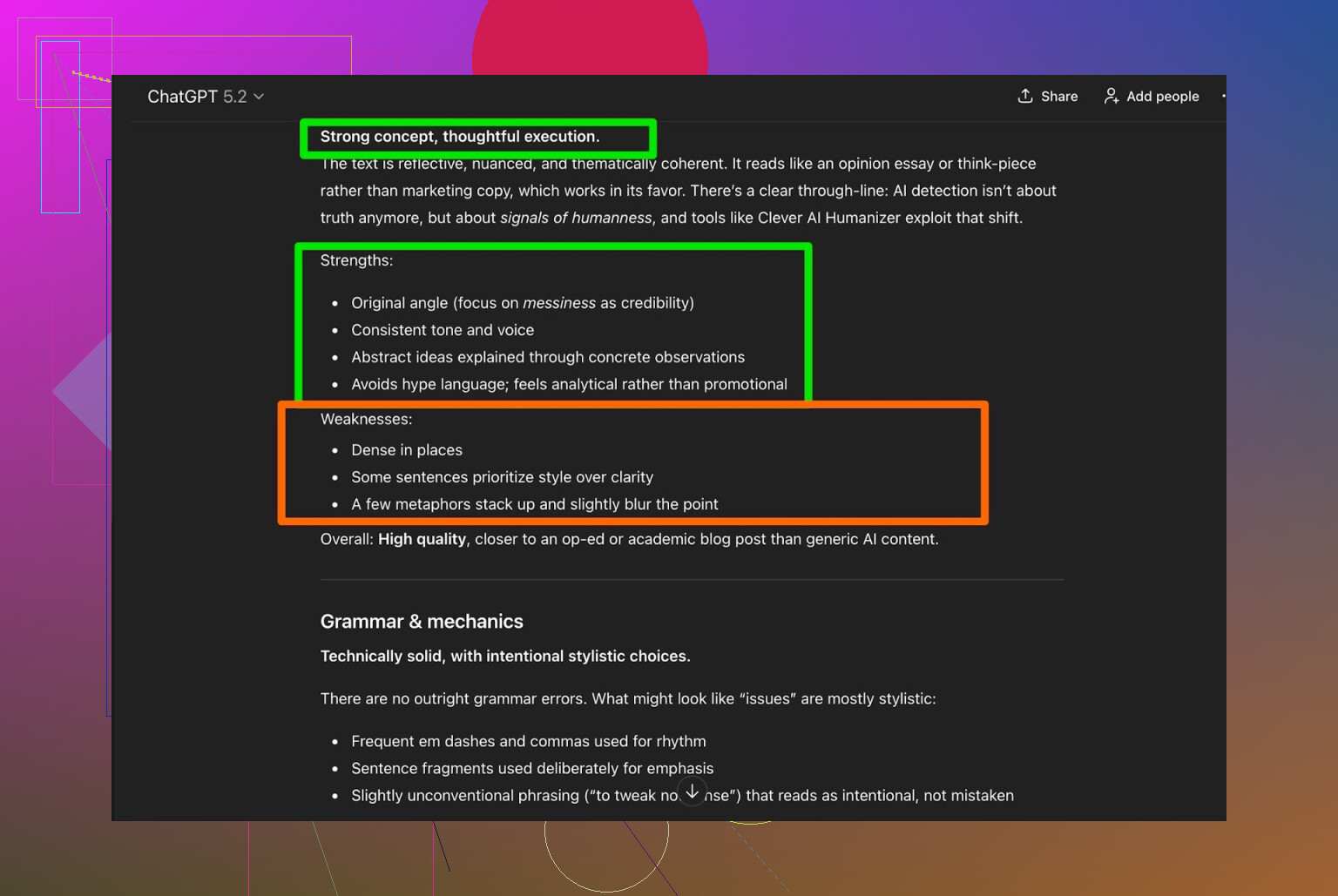

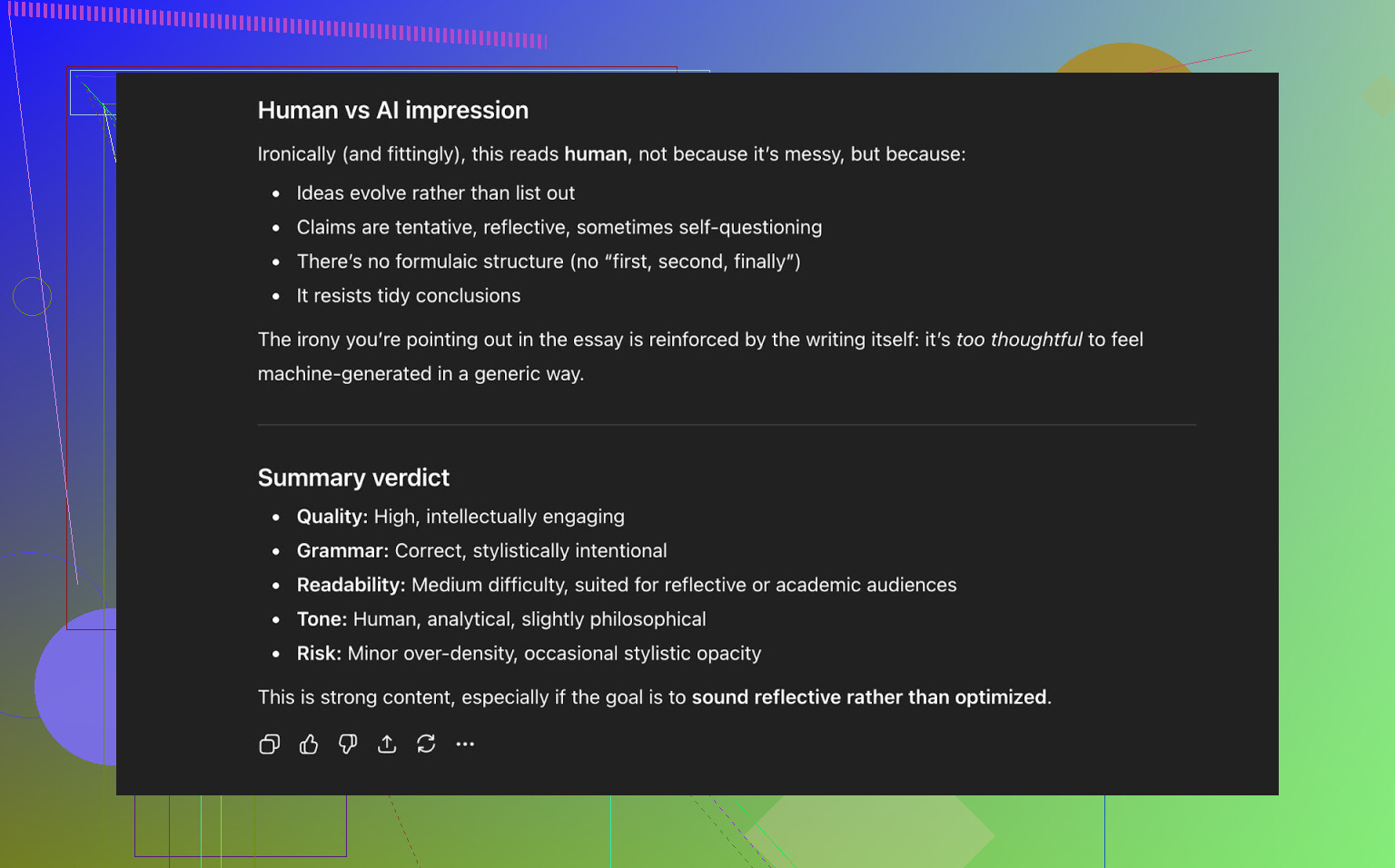

ChatGPT 5.2 如何评价 AI Writer 的结果?

我把这份“写作 + 人类化”的输出再丢回 ChatGPT 5.2,想看看它会不会:

- 直接说这是明显的 AI 文本

- 把质量批得一无是处

- 或者判断为“看起来像人写的”

它的总结是:

- 文本质量:不错

- 可读性:好,读起来自然

- 整体印象:很像人类写作

也就是说,这一轮里,Clever AI Humanizer:

- 在三个不同的 AI 检测器里都拿到了很低甚至 0 的 AI 判定

- 还成功让一个主流大模型认为这篇机器写的文章像人类文本

与其他 humanizer 正面对比

有意思的地方在这里。

在我自己的测试里,Clever AI Humanizer 的表现压过了一堆其他工具,包括免费和付费的:

- Grammarly AI Humanizer

- UnAIMyText

- Ahrefs AI Humanizer

- Humanizer AI Pro

- 一些付费工具比如 Walter Writes AI

- 各种打“隐身绕过检测”旗号的工具:StealthGPT、Undetectable AI、WriteHuman AI、BypassGPT

下面这张是我用相同检测器、相近提示词做出来的对比表:

| Tool | Free | AI detector score |

| ⭐ Clever AI Humanizer | Yes | 6% |

| Grammarly AI Humanizer | Yes | 88% |

| UnAIMyText | Yes | 84% |

| Ahrefs AI Humanizer | Yes | 90% |

| Humanizer AI Pro | Limited | 79% |

| Walter Writes AI | No | 18% |

| StealthGPT | No | 14% |

| Undetectable AI | No | 11% |

| WriteHuman AI | No | 16% |

| BypassGPT | Limited | 22% |

所以在我的测试里,Clever AI Humanizer 一边把 AI 检测分数压到了所有工具里最低,一边还能保持可读性不错。

优点与不足

优点:

- 目前依然免费

- 在主流检测器上,AI 判定分数持续偏低

- 不靠那些“假装人类”的招数,比如故意加错别字或乱塞俚语

- 语法整体比较稳,我自己的感觉和工具评分都在 8–9/10 左右

- 无论是 humanizer 还是 AI Writer,产出的文本都比较顺畅易读

不足:

- 字数控制不精确,如果你必须要刚好 X 个词,多半得自己手工删减

- 有时候会明显偏离原文的措辞或结构,这可能也是它能过检测的原因之一,但如果你希望和原文尽量接近,这点会有点烦

- 一些大模型在深度分析时,仍然能抓到某些模式,把部分段落标成“可能是 AI”

- 如果你经常读 AI 文本,可能还是能隐约感到一点“AI 味”,虽然比大多数工具好很多

关于那些“故意制造错误”的做法

有些工具和教程会建议你把文本质量刻意拉低,比如:

- 把 “I” 写成小写 “i”

- 多用残句、半截句

- 硬塞俚语

- 加一些奇怪的标点

逻辑是:通过模仿“人类的懒散错误”,让文本看起来更自然。

Clever AI Humanizer 看起来并不会这么干。它不会故意往文本里塞错误,只为了绕过检测器,这一点我其实挺认可的。

确实,打破语法规则有时候能稍微影响检测结果,但代价是你的文章看起来像是在公交车上闭着眼睛敲出来的。这对任何正式场景都不是什么好主意。

永无止境的“猫鼠游戏”

当你看得足够多这类文本,会发现一个怪现象:

即使一段文字在这些检测器里显示:

- ZeroGPT:0% AI

- GPTZero:0% AI

- 其他工具:检测很干净

你有时候还是能**“感觉到”**那种 AI 的节奏——同样的句式节拍、类似的措辞模式、保守安全的用词。

Clever AI Humanizer 在掩盖这种感觉方面,比大多数免费工具要好,但这个问题已经不只是某一个网站能解决的了。检测器在进化,人类化工具也在进化,然后双方永远在互相追赶,这就是一个典型的猫鼠游戏。

所以,它并不是一件“隐身斗篷”。它只是目前众多免费工具里,表现比较靠谱的那一个。

那么,Clever AI Humanizer 值得用吗?

如果我们只讨论免费工具,那么以我自己的测试结果来看,现在我会把它排在前列。

它:

- 压过了很多知名的免费选项

- 能和不少付费服务打个平手,甚至更好

- 输出的文本不至于乱七八糟,基本可用

但你还是要保持现实预期:

- 你依然需要自己编辑

- 依然要自己完整读一遍

- 随着检测器更新,你依然有可能偶尔被判 AI

就目前而言,如果你想找一个不用花钱、但依然能把检测分数压得比较低的工具,Clever AI Humanizer 是少数我会真的愿意收藏的那种。

最后再重复一遍,记得用正确的链接:https://aihumanizer.net/

更多讨论与实测截图

如果你想看看别人的测试和截图,这两条 Reddit 讨论算是不错的入口:

-

总体的 “最佳 AI humanizer” 盘点,有检测截图:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=zh -

专门讨论 Clever AI Humanizer 的帖子:

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=zh

断断续续地在客户项目和学校作业里用 Clever AI Humanizer,所以这是去掉废话之后的真实体验。

我同意 @mikeappsreviewer 说的很多点:在检测器上它确实比很多工具好用。但我其实没那么在乎检测分数,我更在乎的是:“这东西我能不能直接交给客户而不觉得丢人?”

我的体验:

它真正厉害的地方

- 文本确实比原始的 ChatGPT/Claude 输出读起来更自然。过渡不那么机械,“总之”“此外”这类模板句明显变少。

- 它在这些场景里表现挺稳:

- 博客开头和结尾

- 社交媒体文案 / 邮件

- 偏轻量的学术或“半正式”内容

- 对大多数非技术读者来说,成品已经足够“像人写的”,一般不会有人追问“你是不是用了 AI?”

让我不爽的地方

- 字数控制很随意。我让它控制在 500 字以内,结果给了我大概 720 字。最后只能自己硬砍一遍才符合客户要求。如果老师或客户对字数卡得很死,这部分只能你自己兜底。

- 有时候它会抹平细微差别。要是你原稿的个人风格很强,Clever AI Humanizer 往往会把这股劲儿磨成一种略带模板感的“写得不错的博客文”。对过检测有好处,但对想要保留个性的人来说就不那么友好。

- 我往里丢非常技术向的内容(代码 / 数据相关)时,它偶尔会简化过头,或者改写得有点“不太对劲”。所以技术内容你必须仔细校对。

关于 AI 检测器

- 在我自己的测试里,它通常能在主流检测器上拿到很低的 AI 评分。但问题是:

- 检测器本身就极其不稳定

- 熟悉你写作风格的人,如果发现你突然写得格外工整和光滑,还是会觉得哪里怪怪的

- 我不会把它当成什么“学术诚信终极护盾”,在高风险的场景里指望它帮你蒙混过关,那就是在赌命。

比较靠谱的工作流

对我来说最稳的是这样用:

- 先用大模型打个草稿(或者你直接自己写)。

- 把草稿丢给 Clever AI Humanizer 跑一遍。

- 然后当成是你自己写的去编辑:

- 加 1–2 个个人经历的小例子

- 把几处表述改成你平时说话/写作的习惯

- 插入一些只有你自己才会知道、比较具体的小细节

这样改完之后,文本就不再像泛泛的 AI 糊出来的东西。到这个阶段,它已经更像是你借助工具完成的作品,而不是单纯的“绕过检测模式”。

总结

-

如果你的目标是:

- 语气更自然

- 行文更顺滑

- 提升在基础 AI 检测器面前的通过率

那 Clever AI Humanizer 确实是我会推荐长期使用的少数工具之一。

-

如果你的目标是:

- 一键生成、立刻发布、完全不用动脑

- 永久、绝对的检测免疫

那它做不到,而且任何正规工具都做不到。

所以,用在“真正的项目”里,把它当成工作流里的一个辅助工具是没问题的。只要别省掉那一步人工修改,也别指望它完美保留你的个人写作风格,或者每次都精准卡在你要求的字数上。

简短结论:它其实还不错,但前提是你把它当成辅助工具,而不是那种“一键点击就能得到人工稿件”的机器。

补充几点,扩展一下 @mikeappsreviewer 和 @cazadordeestrellas 已经说过的内容:

-

语气和风格的保留

- 我不太认同“开箱即用就足够做客户项目”这个说法。

- 我的测试里,Clever AI Humanizer 确实能让文字更顺滑,但也会非常明显地把风格“拉平均”。如果你原本的文风比较古怪、强烈或有个性,它往往会把它抹平,变成一种“礼貌博客腔”。

- 对那些非常依赖特定语气的品牌(比如刻薄、张扬、极简等),你需要再手动改一遍,把个性重新写回去。不然客户会觉得文案慢慢变成“企业 LinkedIn 腔”。

-

内容被过度“消毒”的风险

- 有个怪现象:它有时会把尖锐和有棱角的表达删掉。

- 任何太直接、太“重口”的说法都会被柔化成比较温和的语言。对写学校作文挺好,但对内容营销或观点型文章就不一定是好事,因为这些场景反而需要鲜明、有力的表达。

- 如果你是在写“火辣观点”,要检查一下它有没有把所有内容都稀释成那种“双方都有道理”的平庸废话。

-

长项目的整体一致性

- 在多页项目(报告、长文、多封邮件序列)里,我看到的一个问题是:风格不一致。

- 把 A 段和 B 段分别丢进 Clever AI Humanizer 处理后,读起来并不像同一个人写的。有时候更正式,有时更聊天。

- 对长文或多章节项目,我更建议只把它当作第一遍润色工具,最后还是要自己做一次整体通读,把语气统一好。

-

技术和专业领域的内容

- 对“它会过度简化技术内容”这个说法我很同意,甚至还要再往上加一档:如果你是法律、医疗、数据科学、金融、开发等领域,千万别完全照单全收。

- 它很喜欢“换个说法”,但语义细节会略微偏移——当字词的精确含义特别重要时,这就会出问题。

- 我的做法是:

- 只在引言、过渡句、举例部分使用它。

- 定义、公式、代码、法律或技术条款尽量保留原文,只做轻微人工润色。

-

检测工具 vs 真实读者

- 大家老在聊检测器,但现实里,真正对文本产生怀疑的往往不是工具,而是那些熟悉你平时文风的编辑或上级。

- 对主流 AI 检测工具来说,Clever AI Humanizer 的表现也还可以,但是:

- 如果你的经理平时知道你写东西像一只“混乱小妖精”,突然有一天你写得像职业金牌文案,他会立刻觉得不对劲。

- 所以,如果你是想在学校或工作中“隐藏 AI 痕迹”,你平时写作水平与突然出现的“超光滑文本”之间的落差,其实比检测器分数更可疑。

-

它真正好用的场景

- 给 AI 初稿修顺过渡,消掉那种怪异的衔接感。

- 把非母语英语写作润色成更自然的表达,同时不会变成那种假装口语、又怪又尴尬的“bro 式英语”。

- 把千篇一律的 ChatGPT 腔改得不那么一眼就被看出是模板货。

-

哪些场景我不会只依赖它

- 非常私人的内容:个人陈述、作品集案例故事、创始人信等,它会把真实感和个人味道削弱不少。

- 法律或学术风险很高的文本,在这些场景被质疑“使用 AI”是件大事。你再怎么“人性化处理”,本质上还是 AI 参与写作。

实际使用建议:

-

可以用 Clever AI Humanizer 来:

- 打磨 AI 初稿的流畅度

- 把语气拉到一个比较自然的“类人”基础水平

- 在低到中等风险场景里,稍微缓和一下“被检测器判 AI”的焦虑

-

然后你需要自己再做的是:

- 像认真写作那样再编辑一遍

- 把你自己的习惯说法和词汇加回去

- 添几处只有你本人才会想到的具体、细节化内容

如果你期望的是“把 AI 原稿粘进去,就能不用改一个字直接交稿/发表”,那肯定会失望。把 Clever AI Humanizer 当成写作流程中间的一个还算靠谱的免费工具,它其实是值得留在工具箱里的。

简短版本:Clever AI Humanizer 目前确实算是比较好用的免费选项之一,但它绝对不是那种“丢进去就完事”的工具,而且如果你不留意,它很容易把文字风格磨平。

在 @cazadordeestrellas、@hoshikuzu 和 @mikeappsreviewer 已经分享的基础上,我的看法更侧重于:在什么情况下我会用它,什么情况下我不会用。

Clever AI Humanizer 真正有用的场景

1. 把原始 LLM 稿子变成可读的初稿

如果你的起点是很普通的 ChatGPT 文本,Clever AI Humanizer 通常会:

- 稍微打破一点机械化的节奏

- 拉开句子长短的差距

- 减弱那种“模板化段落”的感觉

我其实有点不同意“只要经常读机器文的人就一定能看出它是 AI”的说法。对于短篇和中篇内容(400–800 字),在你做一遍快速人工修改之后,往往已经“足够像人写的”,即便是挑剔的编辑,在休闲博客或邮件场景下也未必第一眼就怀疑是自动生成。

2. 非母语作者润色语气

这一点它比很多工具更突出:一般不会乱加假俚语,也不会刻意装成“很 Gen Z”的语气。如果你的原文结构没问题、但略显生硬,Clever AI Humanizer 能把语气推向自然、中性的口语,而不会牺牲清晰度。

如果要给 ESL 写作者选一个免费的工具,专门用来把 AI 辅助草稿润到更顺滑,它会是我名单里靠前的选择。

3. 低风险内容的“检测焦虑”缓解

就像前面几位说的,它在主流检测器上的表现还算不错。我不会拿它来做学术或法律层面的风险对冲,但对于:

- 联盟营销博客

- 一般重要程度的客户内容

- 不希望被廉价检测器拦截的冷启动外联

它是一个务实的选项。

它开始惹麻烦的地方

在这里,我比前面几条评论的态度更严一点。

1. 品牌语调和个性

Clever AI Humanizer 往往会把文风统一成“礼貌、略友好、偏博客风”的腔调。

如果你的品牌声音是:

- 非常犀利或反主流

- 强烈的幽默、讽刺感

- 极度简练、有强烈节奏感

它通常会把这些棱角磨掉。@hoshikuzu 也提到类似的问题,我觉得应该更严肃地看待这点。你得预期在事后重新把“锋利感”和节奏感手动加回去。

2. 精度要求高的内容(技术、法律、医疗、金融)

我同意 @mikeappsreviewer 说它会偏离原有结构,但我认为这种“偏移”的严重程度比他说的更高。

在任何“用词 = 责任或正确性”的场景里,Clever AI Humanizer 不该碰:

- 定义

- 公式

- 代码块

- 条款或政策语言

它最多只应该用在导语、结语和简单解释上,且每一句涉及细微差别的内容,都要重新人工复查。

3. 长文的一致性

对于长报告或多章节作品,把不同段落分开丢进 Clever AI Humanizer,往往会产生微妙的语气和正式度差异。@hoshikuzu 提到过这个问题,我也有同样的体验:读起来像是几个训练背景类似、但并非同一位“作者”的人连着写的。

如果你打算在长文中使用它,最好预留一个专门的最终通读阶段,只为统一整体文风。

Clever AI Humanizer 的优缺点

优点

- 免费,而且不像部分“XX humanizer” 克隆那样各种付费墙套路

- 比很多竞品(如 Grammarly 的 humanizer 或 UnAIMyText)更能保证句子通顺,而不是改成乱七八糟

- 不会故意加入错别字或假俚语来骗过检测器

- 自带的写作模式可以一边生成、一边人性化,能规避一部分经典 GPT 痕迹

- 很适合把生硬的 AI 草稿和非母语句子打磨成自然的基础版本

缺点

- 字数控制很差;你几乎总要自己删减或补写

- 很容易把文风压成安全、普通的语气,对强品牌或强个人风格的写作是伤害

- 在用词精确度要求高的领域有风险,可能会悄悄改动原意

- 长项目中语气一致性不稳定,除非你之后亲自统一

- 即便能过掉简单检测器,习惯 AI 文本的高阶模型和人类还是容易“感觉出”那种模式感

我会如何在工作流里使用它

如果你打算在项目里依赖 Clever AI Humanizer,我会把它限定在这样的角色里:

- 先生成底稿(来自 LLM 或粗略人写草稿都可以)。

- 把片段丢进 Clever AI Humanizer,打碎那种明显的机器节奏。

- 然后手动编辑,重点是:

- 文风:加回你自己的措辞、节奏、例子

- 准确性:尤其是技术或法律细节

- 篇幅和结构:增删内容、调整逻辑顺序

对于短到中篇、风险不算高的内容,这套组合完全可行。对于高风险或极具个人色彩的文章,我只会把它当作轻度参考工具,而不是最后一道工序。

所以,Clever AI Humanizer 值得放进你的工具箱,但绝不是你可以丢掉自己编辑判断的理由。